Auf Deine Leseliste in Meine Fotoschule setzen

Auf Deine Leseliste in Meine Fotoschule setzenIn Zusammenarbeit mit

Der Begriff Negativ

Digitale Fotografie und Negativ, wie passen diese beiden Begriffe zusammen?

Einfach fotografieren lernen mit unseren Online-Fotokursen

Für nur 6,99€ im Monat kannst Du auf über 70 Online-Fotokurse zugreifen. Lerne die Grundlagen der Fotografie - verständlich und mit vielen Praxisbeispielen. Inklusive Test und Fotokurs-Zertifikat.

Mehr Infos zu den Fotokursen

Eigentlich stammt der Begriff Negativ noch aus Zeiten der analogen Fotografie. Unter einem Negativ versteht man einen entwickelten Film, schwarz-weiß oder farbig, bei dem das Foto mit umgekehrter Helligkeit (helle Stellen sind dunkel, dunkle Stellen sind hell) und die Farben komplementär dargestellt sind. Erst durch einen Abzug auf zum Beispiel Papier entsteht das wirkliche Foto. Diesen Vorgang nennt man auch Entwicklung.

Macht man mit einer Digitalkamera ein Foto, dann erscheint wenige Augenblicke nach der Aufnahme das Foto auf dem Monitor der Kamera und dieses Foto macht eigentlich einen fertigen Eindruck, kann also kein Negativ sein. Trotzdem wird dieser Begriff immer wieder verwendet, was durchaus plausible Gründe hat, die wir Euch in diesem Beitrag erläutern wollen.

Digitale Sensoren speichern die tatsächlichen Informationen zu dem aufgenommenen Motiv. Allerdings nimmt ein Sensor kein fertiges Foto auf. Der Sensor zeichnet eigentlich pro Pixel nur einen (Zahlen-)Wert für die an dieser Stelle gemessene Helligkeit auf. Das einzelne Pixel kann noch nicht einmal Farben unterscheiden. Aber wie kommt es nun zum fertigen Farbfoto?

Der Weg zum fertigen Farbfoto

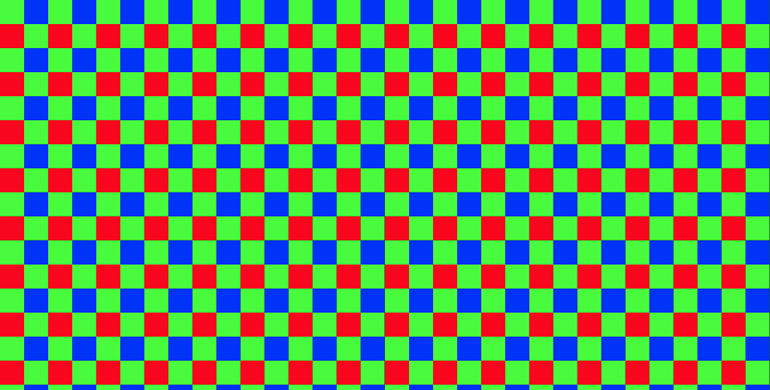

Zum näheren Verständnis haben wir mal einen kleinen Bildausschnitt soweit vergrößert, dass die einzelnen Pixel zu sehen sind und dieses Farbbild dann in reine Helligkeiten umgewandelt, bei der Umwandlung dann aber die Filter der drei Grundfarben angewendet. Ihr könnt deutlich die Unterschiede erkennen, die sich bei der gefilterten Helligkeitsmessung ergeben:

Allerdings zeichnet jedes Pixel immer nur die Werte für eine Farbe auf. Im fertigen Foto hat jedes Pixel wieder Werte für alle drei Grundfarben. Dazu müssen sozusagen für jedes Pixel die beiden fehlenden Farbwerte berechnet werden. Dies geschieht durch die Bayer-Interpolation.

Die Bayer-Interpolation

Der Bildprozessor sucht sich also für jedes Pixel die Werte der umliegenden Pixel der anderen Farben, berücksichtigt dabei Helligkeitsverläufe und Kontrastkanten und interpoliert nach einem mathematisch sehr aufwendigen Verfahren die fehlenden Werte.

Trotzdem liegen nach der Aufnahme die Bilddaten nur in einer Rohform vor, die dann im Signalprozessor der Kamera in ein fertiges Digitalfoto umgewandelt werden. Während dieses Umwandlungsprozesses findet zum Beispiel ein Weißabgleich statt, die Gradation wird angepasst und die Bilder werden geschärft.

![lightbox[article] 20120723-195549](https://fotoschule.fotocommunity.de/wp-content/uploads/2014/08/20120723-195549-1024x682.jpg)

Dieser Prozess ist nicht umkehrbar. Da moderne Computer wesentlich leistungsfähiger sind, als die Signalprozessoren von Digitalkameras, macht es durchaus Sinn, diese Umwandlung der Rohdaten erst nach der Aufnahme am PC durchzuführen und die Einstellungen für jedes Foto individuell vorzunehmen, um so auch kleine Aufnahmefehler auszugleichen.

Hinweise zum RAW-Format

Daher bieten viele Kameras die Option an, die Fotos nicht nur in einem endgültigen Format (meist JPEG) zu speichern, sondern auch in einem Rohformat. Man bezeichnet Fotos in diesem Format generell als RAW (raw (engl. – roh)) – auch wenn die tatsächliche Dateiendung davon abweichen kann. Aber Achtung: Auch wenn Ihr in RAW fotografiert, kann die Kamera das Foto auf dem Monitor anzeigen. Ihr seht aber nicht das RAW selbst, sondern ein in das RAW eingebettetes JPEG, das alle Einstellungen anzeigt, die aber in diesem Fall nachträglich geändert werden können

Da diese Daten ähnlich einem Negativ noch weiter entwickelt werden müssen, um sie ansehen zu können, spricht man dann auch von einem digitalen Negativ.